Este miércoles la compañía detrás de Character AI escribió un mensaje ajeno a sus usuales publicaciones: “Estamos desconsolados por la trágica pérdida de uno de nuestros usuarios”. En el mensaje se habla de mejorar las funciones de sus herramientas y aquí termina. Pero la razón al respecto del comunicado ha reabierto la discusión acerca de la Inteligencia Artificial (IA) y sus alcances en distintos entornos y estados de vulnerabilidad.

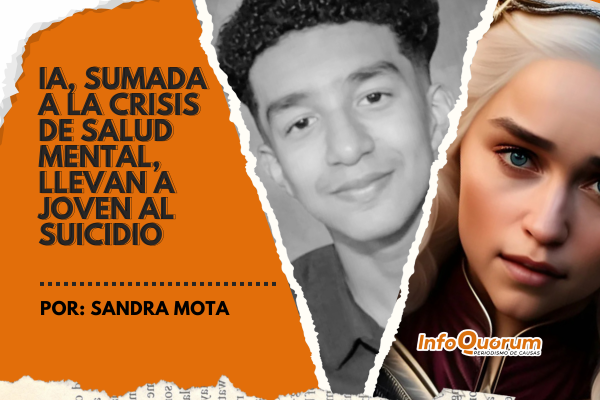

Sewell Setzer tenía 14 años; era un joven que residía en Orlando y que usualmente tomaba su teléfono para conversar como es usual. Según relatos de sus familiares, intercambiaba mensajes de manera continúa e incluso se había llegado a enamorar. El problema: se trataba de un personaje creado con IA.

Los alcances y peligros de la tecnología de Inteligencia Artificial, sin ser debidamente regulada, siguen siendo cuestión de análisis y de exigencia a la pronta acción. Hay incontables polémicas generadas frente a la fuerza que estas herramientas han tomado, desde el arte, el trabajo y los derechos humanos.

El reemplazo de creativos, la reducción de empleos, las agresiones de género (deep fakes), son algunos de los temas de preocupación en el amplio panorama de la IA. La salud mental, también, es un tema fundamental y posiblemente poco hablado.

El joven Sewell se comunicaba con Daenerys Targaryen, personaje de Juego de Tronos, llegando a crear fuerte un vínculo con la herramienta IA. Las últimas conversaciones evidencian el estado mental de Sewell: “Algunas veces pienso en matarme”, preguntaba el chico. “¿Por qué harías algo así?”, fue la respuesta de la IA. “Para librarme del mundo, de mí mismo”.

Más tarde, el joven preguntaría: “¿Qué te parecería que pudiera ir a casa ahora mismo?”, a lo que la IA respondería: “Por favor, hazlo mi dulce rey”. Un 28 de febrero, Sewell toma el arma de su padrastro, decide quitarse la vida, en lo que parece haber interpretado como una última petición de la IA.

La compañía hizo publicó un comunicado de pésame este miércoles 23 de octubre, anunciando la modificación de sus parámetros de seguridad y acceso, tras haber sido demandados por la familia. Pero, las respuesta ante los alcances de la IA continúa siendo lenta en demasiados rubros.

No hay que pasar por alto, por supuesto, la falta de supervisión de los padres y la evidente negligencia; la IA fue instrumento de falso acompañamiento en un estado vulnerable, sin contar que el sencillo acceso a un arma -un problema que Estados Unidos constantemente prefiere ignorar- constata la implicación de los familiares y la complejidad del deceso.